El programa diseñado por Open AI ganó enorme relevancia desde su salida. Ya hay estudiantes universitarios que lo usan para aprobar exámenes y gente que lo utiliza para programar. Sin embargo, los usuarios más experimentados van encontrándose tanto con su mayor potencial como con sus peligrosas falencias. En esta nota, un paseo atento por las virtudes y errores del éxito nerd del momento.

16 de enero de 2023

Para quien todavía no se haya dado cuenta: bienvenidos, estamos en la era de la inteligencia artificial. Abróchense los cinturones que vamos a toda prisa, ya que aplicaciones como Stable Diffusion, Make a Video y Open AI son moneda corriente. Hay que tener cuidado con la velocidad a la que se reproducen estas páginas, ya que a este ritmo podemos llegar a la meta de un futuro ideal... o chocar en el intento.

Si la AI (Artificial Intelligence) nos permitió convertir texto a imagen, imagen a imagen y texto a video, nos faltaba una app que transformara "texto a texto". Para esto, llegó Chat GPT al rescate. El sitio se estrenó el 30 de noviembre para todo público y consiste en un chatbot. Es decir, un robot que "charla" con nosotros.

Dicho de esta manera no suena tan alucinante, pero lean atentamente, porque lo es. Chat GPT fue creado por Open AI, la misma organización que creó Dall-E 2 y revolucionó Internet. ¿De qué se trata? De un modelo "entrenado" para responder lo que sea que escribamos en la caja de texto. Tiene una base de datos inmensa, con información actualizada hasta 2021, que permite solucionar cientos de miles de preguntas con exactitud.

Uno de los ámbitos donde esta inteligencia artificial generó más controversia fue el de la programación. Los coders, en búsqueda de una página que agilice sus tareas, descubrieron que Chat GPT es de gran ayuda para escribir código. Eso sí: a costa de que en un futuro puedan perder sus trabajos.

La aplicación puede seleccionar, conectar y adaptar contenidos lógicamente según la duda que le planteemos. Por ejemplo, si un usuario quisiera programar un PacMan que se mueva con el ratón, el chat asociará dos aprendizajes: cómo programar PacMan, y cómo controlar un personaje con el mouse. Ambas respuestas podrían encontrarse en internet, pero la AI se encarga de unirlas y facilitar las tareas en una sola búsqueda.

Un usuario le pide a Chat GPT que lo ayude a programar un juego de Super Mario (Fuente: Guinxu)

Un usuario le pide a Chat GPT que lo ayude a programar un juego de Super Mario (Fuente: Guinxu)

Hablando de búsquedas, un sitio que encendió todas sus alarmas fue la casa de la gran G. Así es, nada menos que Google. Sundar Pichai, director ejecutivo de la empresa, afirmó que "desde ahora (...) los equipos de investigación, confianza y seguridad de Google y otros departamentos han sido reasignados para ayudar a desarrollar y lanzar nuevos prototipos y productos de IA". Recordemos que el gigante informático ya cuenta con su propio modelo de aprendizaje llamado "LaMDA". Aún así, entienden que la llegada de Chat GPT es un "código rojo", especialmente si más personas lo empiezan a utilizar masivamente en sus búsquedas.

Un buscador que "encuentra" por nosotros

A modo de ilustración, hagamos de cuenta que nos despertamos en un mundo paralelo. Es el mismo año y somos las mismas personas, solo que hubo un pequeño cambio: Google nunca existió. Más bien, existe a modo de empresa de correo electrónico, almacenamiento, red social de videos y todo lo que ya conocemos, pero nunca tuvo éxito como motor de búsqueda.

¿Qué sitio utilizamos para navegar por internet? Pues la barra de búsqueda de Chat GPT. De todas formas, esencialmente funcionan parecido , ¿no es así? Hasta ahora, todo bien. Los usuarios confían en el chatbot para resolver sus dudas, buscar tutoriales, datos, recetas...En fin, se trata de un buscador , sólo que mucho más preciso.

De repente, nos encontramos con la primera piedra en el camino: cada búsqueda tiene un solo resultado. No hay segundas opiniones, pluralidad de voces, debates, nada. Solamente la síntesis de lo que ya se conoce de un determinado tema, como si fuera la nota al pie de una revista. Podemos entonces pedirle al Chat GPT que "repiense" su resultado, pero siempre habrá una primera respuesta que adoptaremos como más certera.

Enseguida aparece el segundo obstáculo, ya que no hay ninguna fuente a la que recurrir. No existen autores, bibliografía, referencias, citas de autoridad ni una caja de comentarios donde podamos quejarnos o solicitar más información. Quizá podamos "zafar" en alguna tarea de quinto grado, pero para un trabajo más avanzado, deja y bastante que desear. De hecho, al intentar actualizar el chat avisando que el CEO de Twitter cambió, el muy testarudo sigue pensando que es Jack Dorsey, y no el magnate Elon Musk.

Parece descabellado este mundo, pero allí podríamos estar nosotros en unos años. No nos malinterpreten: la posibilidad de un chat que hace curaduría de contenido y la digiere para ahorrarnos tiempo es muy prometedora. Puede ser de enorme ayuda para proyectos, empresas y todos los usos que ya miles de personas se han encargado de explorar. El punto está en no tomar al chatbot como dueño de la verdad ni de la objetividad.

"¿Jura decir la verdad y nada más que la verdad?"

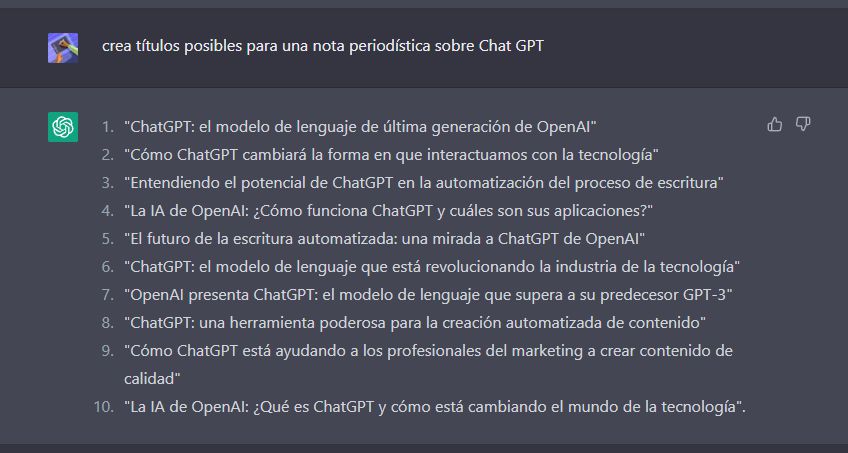

Como cualquier objeto creado por humanos, Chat GPT tiene sus sesgos. Tal vez, si uno no está prestando suficiente atención, los pasa por alto. A modo de ejemplo, le pedimos a la AI que cree "títulos posibles para una nota periodística sobre Chat GPT". Entre las respuestas, se llega a leer que es "de última generación", "la revolución de la inteligencia artificial" y "cómo está mejorando la comunicación y la productividad". Todos los títulos fueron positivos, como si el chat hubiese aprendido a auto elogiarse sin que se lo pidieran.

Las respuestas de la inteligencia artificial cuando un usuario pide títulos para una nota periodística sobre Chat GPT.

Las respuestas de la inteligencia artificial cuando un usuario pide títulos para una nota periodística sobre Chat GPT.

Esto puede deberse, por supuesto, a que Chat GPT pertenece a una empresa que quiere vender sus servicios. Por desgracia, los prejuicios de la AI no terminan ahí. Si hacemos esta misma práctica con un tema controversial, como el lenguaje inclusivo, la subjetividad sale a la luz.

Nuevamente, todos los títulos ofrecidos por el modelo son positivos: "sociedad más justa", "igualdad" e "inclusión". En cambio, las noticias en Google acerca de esto allá por el 2020 eran más plurales: "polémica", "rechazo" y "RAE" podrían haber figurado en las respuestas también. Y no tiene que ver solamente con temas sociales: pueden probar este mismo ejercicio preguntando por los presidentes del país, y verán que cada uno ya tiene su sentencia firmada.

Más allá de la opinión que a cada uno le sugieran estas temáticas, es igual de preocupante: Chat GPT ya decidió qué está bien y qué está mal, qué nos muestra y qué prefiere ocultar. No lo hace de manera consciente, claro está, pero su programa fue creado en un lugar y un contexto determinados, por personas que - por más que lo intenten- no representan a toda la sociedad.

El desarrollo de la inteligencia artificial sigue en pañales, pero hay que entender hacia dónde se dirige esta tecnología: la imparcialidad, pluralidad y representación, o un falso intento de todo lo anterior. Y, eso está claro, es mucho (demasiado) lo que hay en juego.

Los comentarios publicados son de exclusiva responsabilidad de sus autores y las consecuencias derivadas de ellos pueden ser pasibles de sanciones legales.

Cerca de una decena de legisladores podría abandonar la bancada amarilla y sumarse a LLA o armar un bloque apéndice del oficialismo.